AI在國防科技中的應用:自主武器系統倫理探討

當科幻電影的場景走進現實,AI自主武器系統的崛起,迫使我們必須面對一場關於戰爭、人性與道德的深刻辯論。我們真的準備好將生殺大權交給機器了嗎?

當AI的智慧遇上戰爭的殘酷:一場無可迴避的道德辯論

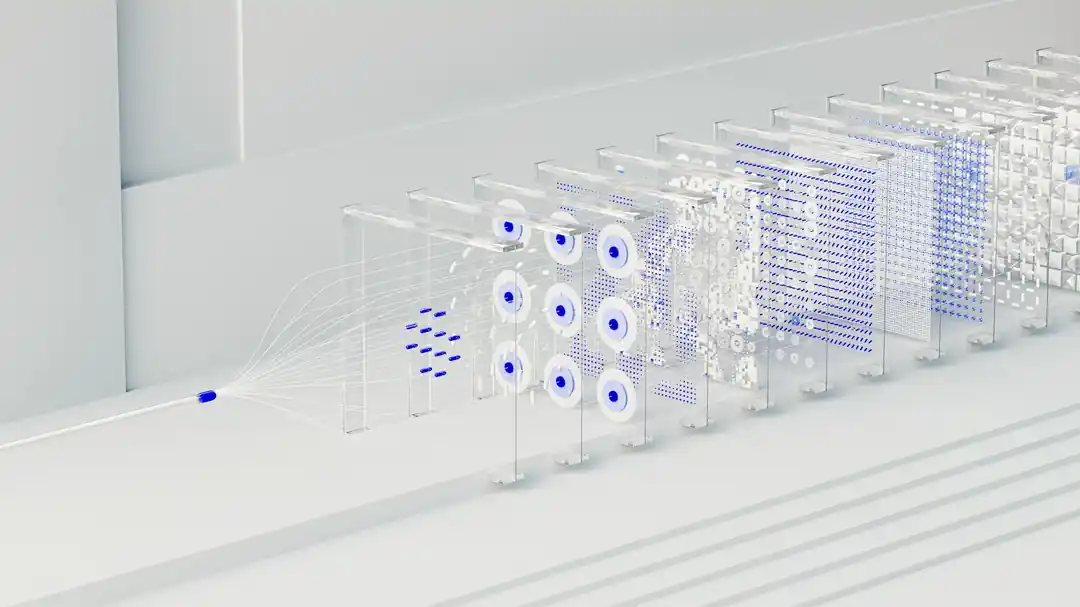

想像一下,未來的戰場上,不再是血肉之軀的士兵,而是由人工智慧驅動的機器人,它們能自主判斷、自主攻擊。這聽起來像是科幻電影的情節,但隨著AI技術的飛速發展,這已經不再是遙不可及的幻想,而是我們必須正視的現實。人工智慧在國防科技中的應用,特別是「致命性自主武器系統」(Lethal Autonomous Weapons Systems, LAWS)的崛起,正將我們推向一個前所未有的道德邊界。這不僅是技術的進步,更是對人性與戰爭本質的深刻詰問。

老實說,我第一次深入研究這個主題時,內心感到一種深沉的不安。我們習慣於AI作為改善生活的工具,從智慧手機的語音助理到推薦我們下一部該看什麼電影。但當這種強大的智慧被賦予決定生死的權力時,整個故事的調性就完全改變了。我們真的準備好,將戰爭中最沉重、最關鍵的決策——奪走一個人類生命的權力——交給一段程式碼嗎?

這場辯論的核心,其實是關於「人類控制」的底線。我們願意退讓到什麼程度?支持者認為,AI武器能更精準、更快速,甚至能減少己方士兵的傷亡。但反對者擔憂,這會開啟一個潘朵拉的盒子,引發新型態的軍備競賽,並侵蝕我們最基本的人類價值。這是一個沒有簡單答案的複雜問題,但我們不能因為它的複雜而選擇迴避。

自主武器的雙面刃:效率與失控的邊緣

自主武器系統的擁護者,特別是部分軍事強權,常常提出其在作戰效率上的巨大潛力。他們主張,這些系統不受情緒、疲勞或恐懼的影響,能在毫秒之間處理龐大的戰場資訊並做出反應。理論上,這能大幅提升打擊的精準度,減少對平民的附帶損害,同時也能讓己方士兵遠離險境。例如,在反制敵方快速來襲的飛彈或無人機群時,AI的反應速度確實遠超人類。

然而,這把鋒利的雙面刃,另一面卻是令人不寒而慄的失控風險。當一台機器被賦予「致命自主權」時,一旦它犯下錯誤——比如誤判情勢,將手無寸鐵的平民當作敵人——責任該由誰來承擔?是撰寫演算法的工程師?是下達部署命令的指揮官?還是製造武器的公司?這形成了一個法律與道德上的「責任真空」,現有的國際人道法在設計時,根本沒有預料到這種由非人類執行決策的戰爭情境。

更深層的擔憂在於,當戰爭的「成本」(尤其是人命的犧牲)看似降低時,發動戰爭的門檻是否也會隨之降低?有學者和人權組織警告,如果決策者認為可以透過派遣機器人來打一場「零傷亡」的戰爭,可能會讓他們更輕易地選擇軍事行動,從而讓世界陷入更頻繁、但同樣殘酷的衝突之中。這不僅沒有帶來和平,反而可能讓戰爭的幽靈,以一種更廉價、更頻繁的形式遊蕩在我們身邊。

道德的灰色地帶:演算法偏見、人性判斷與全球競賽

自主武器系統所引發的道德挑戰,遠比我們想像的更為複雜。其中一個核心問題,就是「演算法偏見」。AI系統是透過大量數據「餵養」而成的,如果這些訓練數據本身就存在著歷史或文化的偏見,那麼AI的決策也會不自覺地複製甚至放大這些偏見。例如,如果一個臉部辨識系統的訓練數據中,某個族裔的樣本不足,它在辨識該族裔時的錯誤率就可能更高,這在戰場上可能導致災難性的歧視性攻擊。

另一個無法迴避的困境,是「人性判斷」的完全缺失。一個受過訓練的人類士兵,在戰場的千鈞一髮之際,可能會因為對方的猶豫、恐懼,或是一個孩子突然闖入的畫面,而做出不開火的決定。這種基於同理心、道德直覺的判斷,是機器無法複製的。機器沒有同情心,不懂得憐憫,它只會冷冰冰地根據預設的參數和感測器數據執行「殺戮」或「不殺戮」的指令。這種缺乏情境理解與道德權衡的「黑箱決策」,正是最令人恐懼的地方。

正因如此,一個名為「停止殺手機器人」(Campaign to Stop Killer Robots)的全球性運動應運而生,集結了數十個國家的人權組織與專家,共同呼籲各國制定具有法律約束力的國際條約,禁止或嚴格限制自主武器的發展與使用。他們擔憂,一旦自主武器的競賽全面展開,將可能引發全球性的不穩定,讓戰爭的升級變得更快、更不可預測。

全球的對話與台灣的省思

面對這項顛覆性的科技,國際社會的反應相當分歧。自2014年起,聯合國就在《特定常規武器公約》(CCW)的框架下,持續召開政府專家會議進行討論,但至今仍未達成共識。美國、俄羅斯等軍事大國,雖然口頭上同意需要某種形式的規範,但對於具有法律約束力的禁令始終抱持保留態度,擔心這會限制自身的國防科技發展。

對於身處複雜地緣政治環境中的台灣而言,這個議題同樣至關重要。發展不對稱戰力,利用無人機等自主或半自主系統來提升防衛能力,已是國防發展的重要方向。我們擁有頂尖的半導體和AI科技人才,這既是我們的優勢,也讓我們肩負著更大的倫理責任。如何在追求國防安全的同時,堅守我們對人權與民主價值的承諾,將是一個嚴肅的課題。

這不僅僅是軍方或政府的責任,更需要整個社會的共同參與和討論。我們需要建立一套清晰、透明的倫理框架和使用準則,確保「有意義的人類控制」(Meaningful Human Control)始終是武器系統運作的核心原則。這意味著,無論AI多麼先進,最終的致命決策權,必須也必然掌握在人類手中。

我們的未來,由我們共同定義

當我們凝視著AI在國防科技領域的無限潛力時,也必須同時審視其可能帶來的深淵。自主武器系統的倫理辯論,不僅僅是關於機器人或演算法,更是關於我們希望建立一個怎樣的世界,以及我們如何定義人類在其中的角色。這是一場全球性的對話,需要政府、學術界、科技產業和每一位公民的共同參與。

科技本身是中立的,但如何使用它,卻反映了我們的價值觀。我們不能讓技術的發展超越了人類的道德底線。最終,我們希望AI能成為守護和平的工具,而非點燃戰火的引信。

這場關於AI與戰爭倫理的討論,沒有終點,只有不斷的探索與調整。願我們都能以智慧和遠見,為後代子孫留下一個更和平、更有人性的世界。

You might also like

金門大橋全攻略:交通、絕美拍照點與在地美食,一次掌握!

它不只是一座橋,更是連結大小金門的感動。想知道怎麼去、哪裡拍最美、附近有什麼必吃美食嗎?這篇集結了所有你需要知道的細節,讓我們一起探索這座海上巨龍的魅力。

選購除濕機,你真的懂嗎?不只乾爽,更是杜絕害蟲滋生的秘密武器

身處潮濕的台灣,除濕機是家家戶戶的標配。但除了讓衣服乾爽,你知道它更是防止害蟲、守護家人健康的關鍵嗎?

換輪胎不再心痛!給台灣車主的終極省錢技巧與注意事項

每次換輪胎都覺得荷包大失血?別擔心,這篇文章將從換胎時機、聰明選購到日常保養,給你最完整的省錢攻略,讓你在台灣開車也能輕鬆兼顧安全與預算。

5G如何引爆萬物聯網革命?不只是快,更是未來生活的關鍵

當5G遇上物聯網(IoT),究竟會擦出什麼樣的火花?這不只關乎更快的網速,它將徹底顛覆我們的生活方式,從智慧城市到自動駕駛,一個全新的智慧時代正加速到來。

血糖高低起伏會影響心情嗎?穩定血糖的飲食方法與菜單推薦

常常覺得情緒像坐雲霄飛車,一下煩躁一下又提不起勁?這可能不只是壓力大,而是你的血糖在悄悄作祟。一起來探索血糖與心情的微妙關係,學會如何用聰明的飲食方法,找回內心的平靜。